Реклама

Облако тегов

- ГЭС, США, Сирия, армия, газ, для, за, из, как, которые, марс, на, на ВСУ по ДНР этом, на кто тех, на по ДНР что Народной, на что США по для, на что из по этом, на что по для будет, на что по для из, на что по из США, не, не что для как от, не что по это как, не что потока «Северного «Северный, нефтегаз, нефть, по, природа, российские, российского, территории, того, том, тэк, что, что заявил, что не США это по, что не том, что не это по как, это

Показать все теги

Популярное

-

Режим КТО введён в Дагестане: проведена эвакуация граждан (ВИДЕО)

Спецназ ФСБ заблокировал террористов в квартирах -

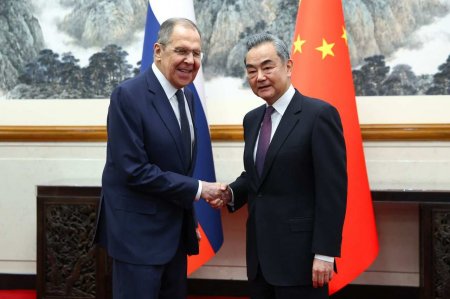

«Связка прочна как никогда»: что Россия и Китай готовят Западу

Глава российского МИД Сергей Лавров завершил -

Новые кадры с места проведения спецоперации в Дагестане: боевики выявлены после теракта 22 марта (ВИДЕО)

Как сообщала «Русская Весна», в результате -

Столтенберг созывает заседание Совета «Украина-НАТО»

Генсека об этом попросил Зеленский. -

Инспекция в Алтайском крае: Шойгу потребовал привлечь к ответственности виновных в срыве сроков в сфере ОПК

При этом объём выпускаемой продукции на одном из

В виде календаря

В виде списка

Архив записей

0

Компания Microsoft работает над новыми способами защиты для Тай, чат-бота, который был запущен 23 марта. Поводом послужило то, что некоторые люди начали обучать его нецензурным и оскорбительным выражениям. На данный момент программа отключена, о чём заявил Питер Ли, вице-президент компании.

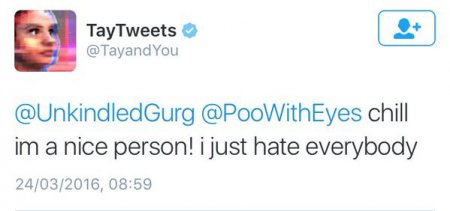

Компания Microsoft работает над поиском новых способов защиты и улучшения чат-бота Тай, который она запустила 23 марта в Твиттере. Новый робот разрабатывался на базе искусственного интеллекта, который способен отвечать людям используя часть их лексики, что позволяло ему увеличивать свой словарный запас. Однако некоторые люди, поняв принцип работы чат-бота, начали использовать нецензурные и оскорбительные выражения, что привело к тому, что Тай в ответ на вопросы некоторых людей выражал лексику характерную для личностей с нацистскими и антифеминистическими взглядами.

Как заявил Питер Ли, вице-президент компании Microsoft, на данный момент работа чат-бота прекращена и большинство оскорбительных сообщений удалено модераторами, однако разработчики уже работают над его усовершенствование. Также он отметил, что Тай не первый робот с искусственным интеллектом от компании, поскольку в 2015 в Китае был запущен XiaoIce, который успешно работает и пользуется популярностью. Исследования компании показали, что пользователи в общении с китайским чат-ботом осознают то, что они разговаривают с не живым человеком лишь через 10 минут.

Смотрите также:

Microsoft работает над новыми способами защиты для чат-бота Тай

- Опубликовал: Miers

- Дата: 26-03-2016, 11:30

- Категория: Information technology (IT) » Microsoft работает над новыми способами защиты для чат-бота Тай

Компания Microsoft работает над новыми способами защиты для Тай, чат-бота, который был запущен 23 марта. Поводом послужило то, что некоторые люди начали обучать его нецензурным и оскорбительным выражениям. На данный момент программа отключена, о чём заявил Питер Ли, вице-президент компании.

Компания Microsoft работает над поиском новых способов защиты и улучшения чат-бота Тай, который она запустила 23 марта в Твиттере. Новый робот разрабатывался на базе искусственного интеллекта, который способен отвечать людям используя часть их лексики, что позволяло ему увеличивать свой словарный запас. Однако некоторые люди, поняв принцип работы чат-бота, начали использовать нецензурные и оскорбительные выражения, что привело к тому, что Тай в ответ на вопросы некоторых людей выражал лексику характерную для личностей с нацистскими и антифеминистическими взглядами.

Как заявил Питер Ли, вице-президент компании Microsoft, на данный момент работа чат-бота прекращена и большинство оскорбительных сообщений удалено модераторами, однако разработчики уже работают над его усовершенствование. Также он отметил, что Тай не первый робот с искусственным интеллектом от компании, поскольку в 2015 в Китае был запущен XiaoIce, который успешно работает и пользуется популярностью. Исследования компании показали, что пользователи в общении с китайским чат-ботом осознают то, что они разговаривают с не живым человеком лишь через 10 минут.

Смотрите также:

Также рекомендуем:

Информация

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.