Реклама

Облако тегов

- ГЭС, Оперативная из военных за на, США, Сирия, армия, были, газ, для, за, из, как, которые, марс, на, на ВСУ по ДНР этом, на кто тех, на что США по для, на что море Черном НАТО, на что по США России, на что по как это, не, не что для как от, не что по это как, не что потока «Северного «Северный, нефтегаз, нефть, по, российские, российского, снарядов, того, том, тэк, что, что заявил, что не США это по, что не том, что не это по как, что сообщает, это

Показать все теги

Популярное

-

ВС РФ продвигаются на Авдеевском направлении

Группировка войск «Центр» вошла на окраину с. -

Американский генерал признал, что учения НАТО проводятся против России

Этой весной около 90 тыс. военнослужащих НАТО -

Байден подписал закон о финансировании конфликта на Украине

Президент США также обвинил Китай, Иран и -

Шольц: мы — страны НАТО — не воюем с Россией

Канцлер Германии сделал очередной громкое -

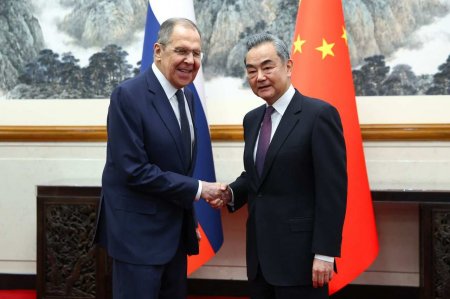

«Связка прочна как никогда»: что Россия и Китай готовят Западу

Глава российского МИД Сергей Лавров завершил

В виде календаря

В виде списка

Архив записей

0

Полиция Великобритании пилотирует проект, использующий искусственный интеллект (ИИ) для определения, насколько вероятно, что кто-то замышляет преступление или может стать жертвой серьезного преступления.

К ним относятся преступления, связанные с оружием (огнестрельным или холодным), а также современное рабство, сообщает New Scientist в понедельник. Надежда состоит в том, чтобы использовать эту информацию для выявления потенциальных преступников или жертв и вмешиваться в события при помощи консультантов или социальных служб до совершения преступлений.

Названная National Data Analytics Solution (NDAS), система извлекает данные из баз местной и национальной полиции. Ян Доннелли, руководитель от полиции по проекту, сказал New Scientist, что они уже собрали более терабайта данных из этих систем, включая журналы совершенных преступлений и около 5 миллионов идентифицируемых людей.

Исходя из этих данных, система имеет 1400 показателей, которые могут помочь отметить кого-то, кто может совершить преступление, например, сколько раз кто-то совершил преступление в прошлом. Люди в базе данных, которые помечаются алгоритмом системы как подверженные насильственным действиям, получат «оценку риска», сообщает New Scientist, которая сигнализирует об их шансах совершить серьезное преступление в будущем.

Полицейский отдел Уэст-Мидлендс получит пробный проект в конце марта 2019 года, и к тому времени будет готов прототип. По сообщениям, есть также восемь других полицейских подразделений на очереди, и разработчики надеются, что в конечном итоге система будет использоваться во всех полицейских департаментах Великобритании.

Доннелли сказал, что они не планируют арестовывать кого-либо до того, как он совершил преступление, но что хотят предоставить консультацию тем, кто, как указывает система, могут нуждаться в этом. Он также отметил, что в последнее время сократилось финансирование полиции, поэтому что-то вроде NDAS может помочь упорядочить и определить приоритетность процесса определения того, кто в базах данных больше всего нуждается во вмешательстве.

Даже если намерения добрые, легко представить, что такая система может иметь опасные последствия. Во-первых, существует серьезное вторжение в личную жизнь. Эта система отправляет специалистов по психическому здоровью в дома людей, потому что алгоритм предполагает, что в будущем есть вероятность совершения преступления или что они могут стать жертвой. Рисуется картина ужасного навязчивого будущего.

Кроме того, все еще есть множество вопиющих проблем с системами обнаружения на основе ИИ. Они не свободны от предвзятости, это также означает, что лица, живущие в районах, находящихся под большим контролем, подвергаются наибольшему риску быть помеченными.

Васильев Виталий

Смотрите также:

Британские полицейские получат ИИ, который определяет замышляющих преступления людей

- Опубликовал: Babcock

- Дата: 28-11-2018, 19:30

- Категория: Человек » Британские полицейские получат ИИ, который определяет замышляющих преступления людей

Полиция Великобритании пилотирует проект, использующий искусственный интеллект (ИИ) для определения, насколько вероятно, что кто-то замышляет преступление или может стать жертвой серьезного преступления.

К ним относятся преступления, связанные с оружием (огнестрельным или холодным), а также современное рабство, сообщает New Scientist в понедельник. Надежда состоит в том, чтобы использовать эту информацию для выявления потенциальных преступников или жертв и вмешиваться в события при помощи консультантов или социальных служб до совершения преступлений.

Названная National Data Analytics Solution (NDAS), система извлекает данные из баз местной и национальной полиции. Ян Доннелли, руководитель от полиции по проекту, сказал New Scientist, что они уже собрали более терабайта данных из этих систем, включая журналы совершенных преступлений и около 5 миллионов идентифицируемых людей.

Исходя из этих данных, система имеет 1400 показателей, которые могут помочь отметить кого-то, кто может совершить преступление, например, сколько раз кто-то совершил преступление в прошлом. Люди в базе данных, которые помечаются алгоритмом системы как подверженные насильственным действиям, получат «оценку риска», сообщает New Scientist, которая сигнализирует об их шансах совершить серьезное преступление в будущем.

Полицейский отдел Уэст-Мидлендс получит пробный проект в конце марта 2019 года, и к тому времени будет готов прототип. По сообщениям, есть также восемь других полицейских подразделений на очереди, и разработчики надеются, что в конечном итоге система будет использоваться во всех полицейских департаментах Великобритании.

Доннелли сказал, что они не планируют арестовывать кого-либо до того, как он совершил преступление, но что хотят предоставить консультацию тем, кто, как указывает система, могут нуждаться в этом. Он также отметил, что в последнее время сократилось финансирование полиции, поэтому что-то вроде NDAS может помочь упорядочить и определить приоритетность процесса определения того, кто в базах данных больше всего нуждается во вмешательстве.

Даже если намерения добрые, легко представить, что такая система может иметь опасные последствия. Во-первых, существует серьезное вторжение в личную жизнь. Эта система отправляет специалистов по психическому здоровью в дома людей, потому что алгоритм предполагает, что в будущем есть вероятность совершения преступления или что они могут стать жертвой. Рисуется картина ужасного навязчивого будущего.

Кроме того, все еще есть множество вопиющих проблем с системами обнаружения на основе ИИ. Они не свободны от предвзятости, это также означает, что лица, живущие в районах, находящихся под большим контролем, подвергаются наибольшему риску быть помеченными.

Васильев Виталий

Смотрите также:

Также рекомендуем:

Информация

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.